#77 Tudo Sobre o o1 - o Novo Modelo da OpenAI -, Adobe Lançando AI de Geração de Vídeos e 8 Novidades de AI da Microsoft

Mais uma semana de avanços no universo das Inteligências Artificiais Generativas!

E, como aqui você não perde nada do que acontece, esta edição está recheada de assuntos interessantes e relevantes. Os temas de hoje são:

Tudo sobre o o1 - novo modelo da OpenAI; Adobe lança modelo de geração de vídeos; 8 novidades de AI da Microsoft; Ferramenta de AI para Youtubers; Rede social de AIs.

News

Tudo sobre o o1 - novo modelo da OpenAI

Finalmente o mistério do projeto Strawberry/Q* da OpenAI foi revelado!

Como nós havíamos previsto na última newsletter, a empresa acaba de lançar um novo modelo de inteligência artificial que consegue raciocinar de forma semelhante a um humano!

O seu nome é o1 e ele é treinado para passar mais tempo pensando nos problemas antes de responder, assim como uma pessoa faria.

Como?

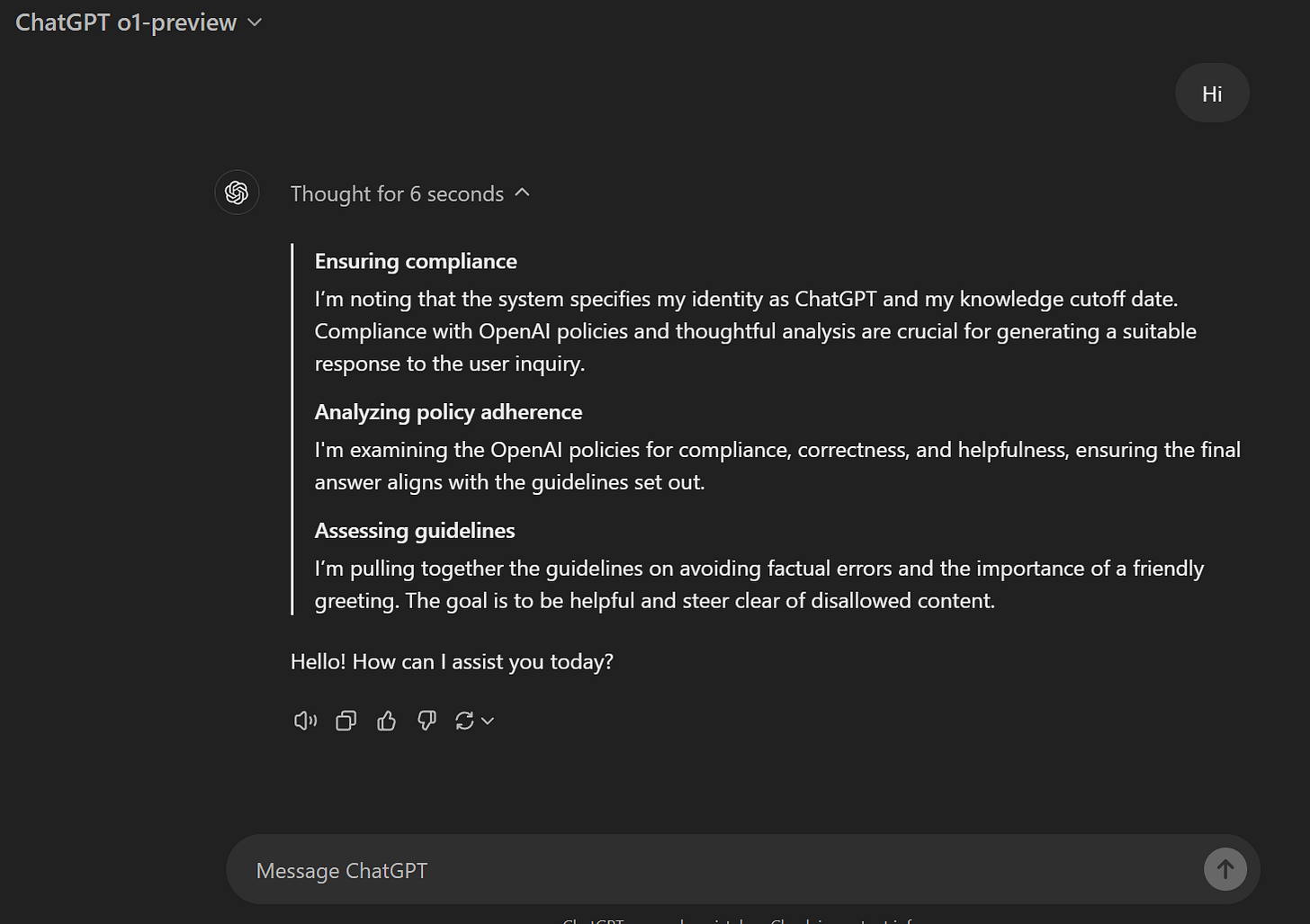

Basicamente, quando alguém envia uma pergunta ou solicitação para ele, ele vai passar alguns segundos até um minuto ou dois refletindo sobre a questão, refinando seu processo de pensamento, tentando estratégias diferentes e reconhecendo e corrigindo seus erros antes de responder.

Dá só uma olhada nesse vídeo onde o o1 resolve um desafio linguístico. Por 39 segundos, ele raciocina sobre a questão e, após estar confiante de que cumpriu os requisitos, dá a resposta.

Em comparação, se o GPT-4o recebesse a mesma questão, responderia na mesma hora e provavelmente erraria.

Isso, pois esse tempo extra de pensamento faz toda a diferença:

É como o “Sistema 1” e “Sistema 2” do livro Rápido e Devagar, de Daniel Kahneman. O Sistema 1 corresponde a um pensamento rápido e intuitivo, enquanto o Sistema 2 envolve um processamento mais lento, deliberado e analítico. Nós costumamos sempre usar o Sistema 1 como padrão, o que nos poupa energia para resolver tarefas simples, mas nos faz tomar muitas decisões ruins em tarefas mais complexas, onde o Sistema 2 entra em ação.

Os modelos de AI funcionam de maneira parecida.

Assim, enquanto o GPT-4o pensa com o Sistema 1, o o1 é feito para ser como o Sistema 2 - pensando por mais por mais segundos, aumentando o seu tempo de inferência.

Com isso, o o1 tem um raciocínio muito mais avançado que qualquer outra Inteligência Artificial, saindo-se muito bem em tarefas que exigem pensamento complexo, como problemas matemáticos, programação de alto nível, ou questões científicas.

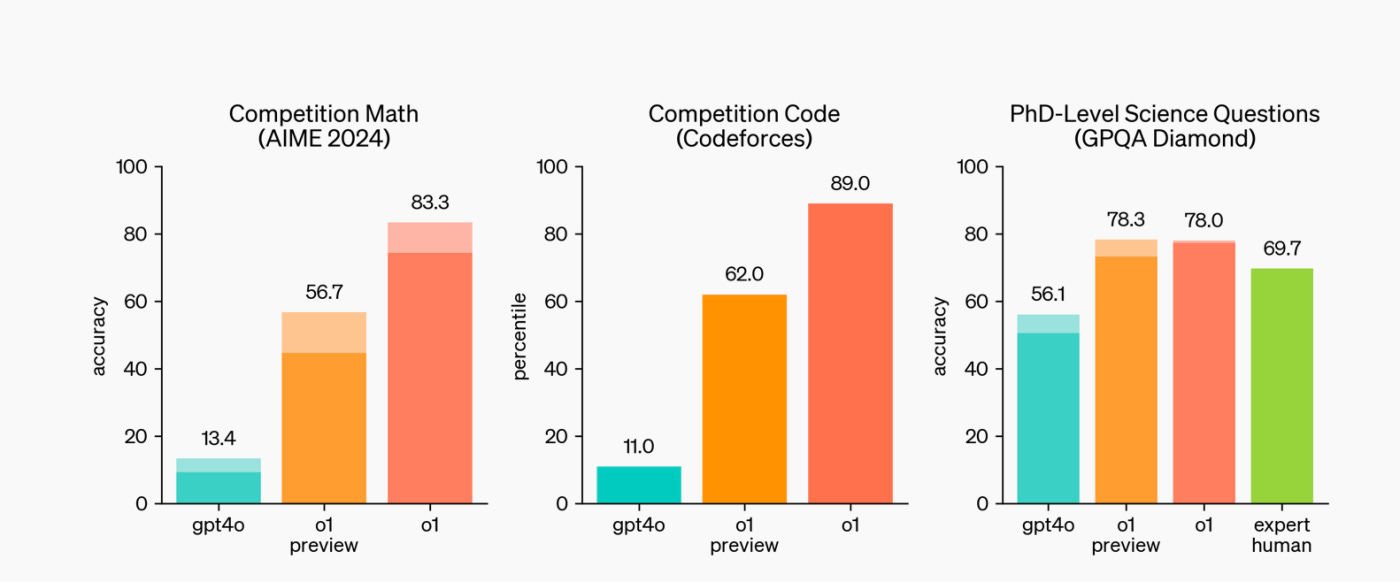

E quando testado nos principais benchmarks, o modelo não decepcionou.

Em um teste competitivo de programação (Codeforces), o desempenho do o1 se posicionou no 89º percentil (o GPT-4o ficou apenas no 11º).

Já em matemática, no AIME 2024, um exame de matemática avançada para estudantes de ensino médio nos EUA, enquanto o GPT-4o resolveu só 13% dos problemas, o o1 conseguiu solucionar 83% - o que o colocaria entre os 500 melhores alunos dos país.

Outro resultado impressionante do o1 é seu desempenho em benchmarks científicos, como o GPQA diamond, que testa habilidades em física, biologia e química. Nesses testes, o o1 conseguiu superar a performance de PhDs humanos (78% de acerto do o1 contra 69% de PhDs).

De forma geral o o1 superou o GPT-4o em praticamente todos os testes, incluindo 54 das 57 categorias do MMLU, um benchmark que mede o desempenho em raciocínio e conhecimento geral.

Contudo, vale mencionar que em tarefas mais subjetivas e que não envolvem um raciocínio muito aprimorado, o o1 não apresentou melhorias frente ao GPT-4o.

O modelo realmente parece raciocinar em um nível completamente novo para os modelos de AI, o que é incrível.

Mas como exatamente ele foi treinado pela OpenAI para que atingisse tamanho desempenho?

Não foram revelados detalhes muito específicos sobre o treinamento ou o funcionamento do modelo.

O que se sabe é que o modelo foi treinado usando um método conhecido como aprendizado por reforço. No aprendizado por reforço, o modelo aprende a resolver problemas recebendo recompensas ou penalidades com base em seu desempenho, permitindo que ele refine suas estratégias ao longo do tempo.

Assim, usando de aprendizado por reforço, eles fizeram com que o modelo gerasse longas cadeias de pensamento - respostas que seguem um raciocínio passo a passo - cada vez mais coerentes, uma vez que eles recompensavam as que levavam a respostas corretas.

Além disso, acredita-se que o o1 tenha um “tamanho” semelhante ao GPT-4o, mas não há nenhuma confirmação oficial.

De qualquer forma, mais detalhes sobre a sua arquitetura talvez sejam revelados em breve.

Sobre a disponibilidade, por enquanto a versão principal do o1 não está lançada - essa versão deverá ser disponibilizada no mês que vem. Mas a OpenAI já lançou duas versões do modelo:

o1-preview: como o nome já diz, é uma prévia do o1. Uma versão muito capaz, porem ainda sem tudo que o o1 pode entregar em termos de performance.

o1-mini: um modelo menor e mais barato que o o1-preview, o que o torna um modelo eficiente e econômico para aplicações que exigem raciocínio, mas não amplo conhecimento do mundo.

Ambas as versões já podem ser acessadas no ChatGPT por usuários dos planos Plus e Team. Nesse primeiro momento, só é possível enviar textos para o novo modelo, ele não aceita documentos ou imagens, nem acessa a web ou usa o code interpreter.

E o o1-preview tem um limite de mensagens de 50 por semana e o o1-mini de 50 por dia.

Esses limites são por conta do maior custo por resposta que esses modelos têm, afinal o tempo adicional que o modelo passa refletindo antes de responder demanda uma quantidade significativamente maior de poder computacional.

Colocando em números, o preço do o1-preview via API é 6 vezes maior do que o do GPT-4o, enquanto o do o1-mini é 20% mais caro que o GPT-4o, mesmo sendo um modelo bem menor. Vale mencionar que, na API, os dois modelos por enquanto só estão disponíveis para um pequeno grupo de usuários.

Em resumo, o o1 é um modelo treinado para passar mais tempo raciocinando, o que melhora muito o seu desempenho em tarefas difíceis e complexas, mas também aumenta o seu custo por resposta.

Com esse lançamento, não é exagero dizer que a OpenAI atinge pela primeira vez uma AI de nível 2, isto é, capaz de raciocinar e solucionar problemas como um humano - falamos desses estágios das AIs na última newsletter.

Junto disso, se forma um novo paradigma no meio. Agora os modelos não terão suas capacidades limitadas apenas pelo seu tempo de treinamento ou pelo seu número de parâmetros, mas também pelo tempo seu tempo de inferência (tempo que ele passa respondendo).

Assim, teremos modelos cada vez “maiores” e que pensam por cada vez mais tempo. E espera que esse aumento em ambas as variáveis traga ganhos proporcionais em termos de performance e “inteligência”.

Por isso, esse lançamento é muito animador.

Eu recomendo que você experimente o o1. Mande questões difíceis e complexas, veja o ChatGPT pensar - leia o seu raciocínio, entendendo como ele chegou na suas respostas - e teste seus limites. É bem legal!

Fazia algum tempo que não falávamos de um lançamento tão interessante como esse. Mas os avanços continuam…

Adobe lança modelo de geração de vídeos

A Adobe, empresa por trás de vários softwares criativos, está lançando o seu novo modelo de geração de vídeos com Inteligência Artificial.

Em março do ano passado, ela lançou o Adobe Firefly, seu modelo de geração de imagens com AI. O modelo tinha uma qualidade muito boa para época e foi integrado às plataformas da Adobe, principalmente sob a funcionalidade Generative Fill no Photoshop - que ficou bem popular e permite que os usuários expandam, preencham e reimaginem partes de imagem.

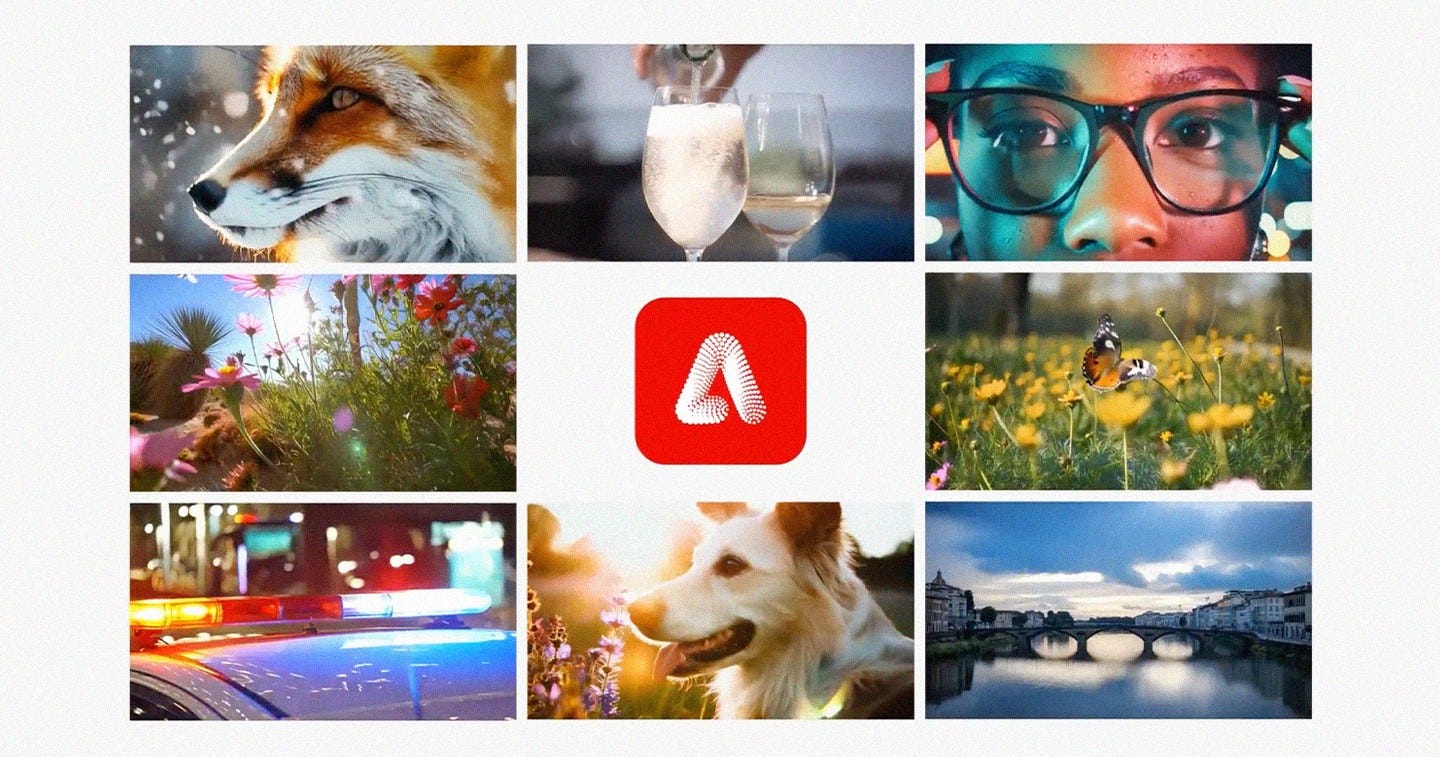

E agora está entrando na área de geração de vídeos com o Adobe Firefly Video.

O novo modelo é capaz de gerar videos com AI a partir de comandos de texto, imagens e outros vídeos. Treinado a partir de bases de dados licenciadas pela Adobe ou de domínio público ele é anunciado pela Adobe como ético e comercialmente seguro.

Apesar disso não ser 100% verdadeiro - pois uma parte das bases de imagens e vídeos que a empresa usa foram geradas por outras AIs, como Midjourney, que por sua vez foram treinadas em imagens com direitos autorais - esse é um dos diferenciais do modelo.

Falando do que interessa, o Firefly Video consegue gerar vídeos de até cinco segundos de duração, mas esse número deve ser aumentado em breve.

Sobre a qualidade dos vídeos gerados, os exemplos disponibilizados são bastante impressionantes, principalmente em vídeos que envolvem maior realismo - gravações de pessoas, natureza, animais.

A qualidade é bem a par com os outros modelos e ele consegue gerar vídeos com boa consistência temporal, beleza e criatividade.

Algo bem interessante são as funcionalidades que virão junto com esse modelo, que permitirão o usuário ter mais controle em sua criação e ampliar os casos de uso. Dá só uma olhada em algumas delas, que vão além texto para vídeo:

Image-to-video: essa funcionalidade transforma imagens estáticas enviadas pelo usuário, como fotografias ou ilustrações, em vídeos animados, adicionando movimento e vida.

Controle de câmera: o usuário pode ter controle sobre ângulos (“aéreo”, “de cima para baixo”, etc.), movimento (“aproximando”, “afastando”, etc.) e zoom da câmera (“fechado”, “aberto”, etc.) nos vídeos gerados, permitindo uma personalização completa para ajustar à perspectiva e à narrativa.

Complemento: com essa funcionalidade é possível enviar um vídeo e obter um novo vídeo que o complemente. Por exemplo: enviar o vídeo de alguém vendo uma flor com uma lupa e pedir para gerar um vídeo que ilustre o que aquela pessoa está vendo. Essa é bem legal e parece funcionar bem.

Elementos atmosféricos: crie sobreposições de efeitos visuais, como fogo, fumaça, poeira e partículas, que podem ser gerados em fundo verde ou preto, para serem combinados a filmagens reais, utilizando ferramentas como Premiere Pro ou After Effects.

Generative extend: essa função é como o Generative Fill, mas nesse caso permite ampliar clipes existentes, suavizar transições entre dois clipes e ajustar a duração de tomadas para adequá-las ao ritmo do vídeo. Ela será disponibilizada no Premiere Pro (beta) até o final de 2024 e é uma excelente aplicação para a geração de vídeos.

Estas e outras funcionalidades, assim como o modelo Firefly Video estarão disponíveis para o público muito em breve e antes do fim do ano.

Você pode se inscrever na lista de espera para ser notificado quando o acesso for liberado e, quem sabe, poder experimentar antes da maioria das pessoas. É só clicar aqui.

Posso dizer que esse modelo está bastante a par com os outros modelos lançados recentemente, como o Dream Machine, Runway Gen-3, Kling e etc. As funcionalidades extras o tornam um dos mais atraentes para os usuários que gostam de levar a geração para um outro nível e para aqueles que já utilizam os softwares da Adobe.

E nesta altura, podemos afirmar que os modelos de geração de vídeo com AI estão rapidamente se multiplicando e não vai demorar até que eles sejam bem baratos de se utilizar, gerem vídeos longos e impossíveis de diferenciar dos reais e estejam completamente integrados em qualquer ferramenta de criação.

Então continuaremos a trazer novidades sobre eles!

8 novidades de AI da Microsoft

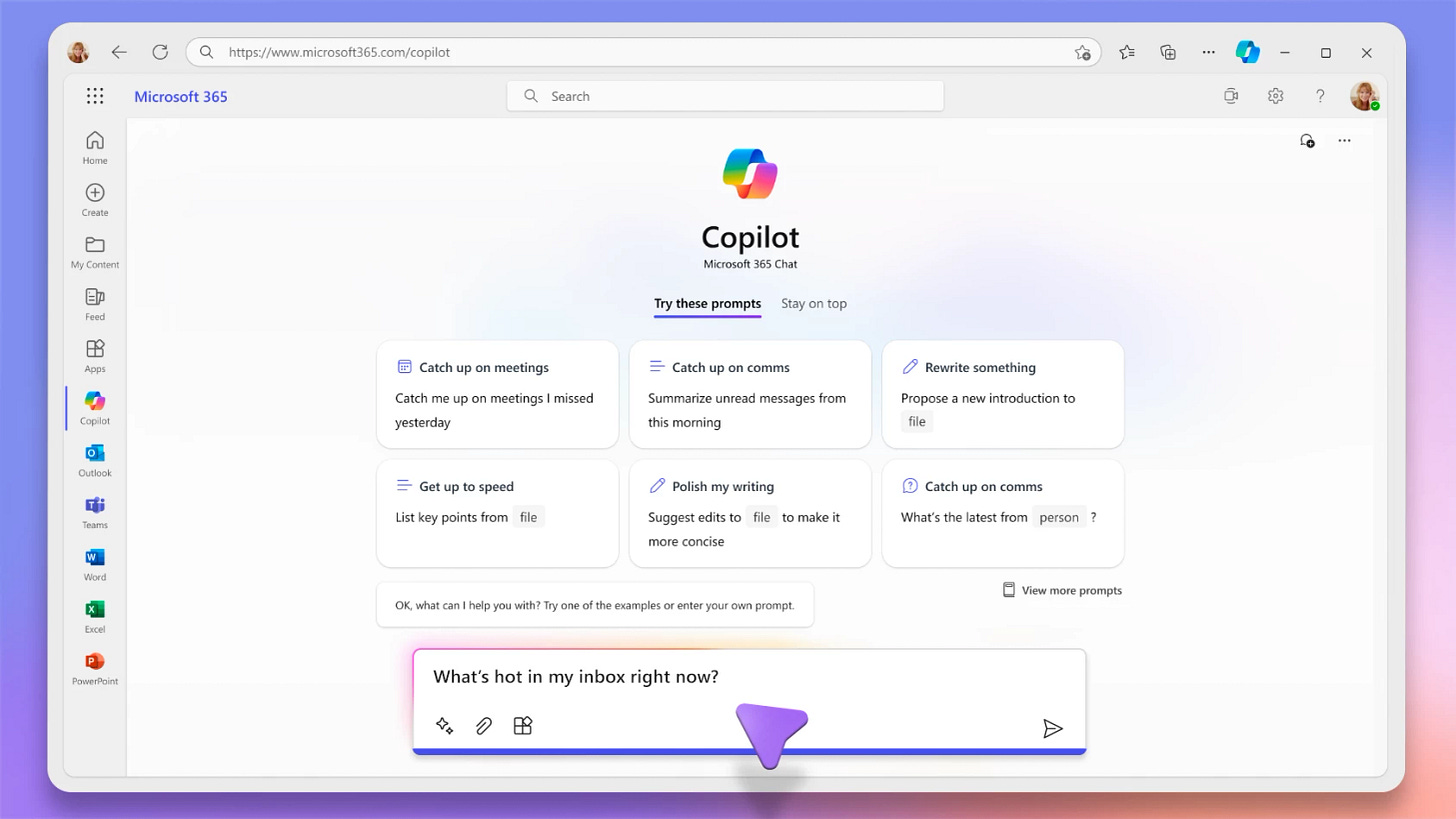

Na última segunda feira (16), ocorreu o “Microsoft 365 Copilot: Wave 2”, um evento online que trouxe uma série de novidades de AI para os apps da Microsoft.

Para quem não conhece, o Copilot é um assistente de AI da Microsoft, que utiliza o GPT-4o da OpenAI e é integrado aos principais aplicativos do Microsoft 365, como Word, Excel, PowerPoint, Teams e Outlook.

O seu objetivo é ajudar os usuários a realizar tarefas com mais eficiência e produtividade, automatizando processos, fornecendo insights e otimizando a colaboração entre equipes.

Essa integração AI + Microsoft 365 já ocorre a mais de um ano e muitas pessoas já experimentaram o Copilot na prática. Após coletar muitos feedbacks de seus usuários, a Microsoft implementou uma série de melhorias e funcionalidades de AI nos seus apps.

Essas novidades foram anunciadas no evento do início da semana e eu separei as mais relevantes para trazer aqui na newsletter.

BizChat e Copilot Pages

BizChat: Apesar deste nome horrível, o BizChat é uma das grandes inovações dessa nova onda do Microsoft 365 Copilot.

Uma abreviação de Business Chat, ele é como um chat centralizado que reúne e acessa todas as informações da sua empresa - documentos, planilhas, apresentações, aplicativos e até informações da internet.

O objetivo do BizChat é facilitar a interação dos membros das empresas com todos os seus dados. Assim, nesse chat geral, eles podem conversar com a AI para obter informações, gerar relatórios e realizar outras tarefas de forma eficiente.

É bastante útil e poupa muito tempo.

Copilot Pages: o Copilot Pages surge a partir do BizChat.

A ideia é que os usuários possam transformar as conversas efêmeras e individuais que têm com o a AI no BizChat em algo duradouro e colaborativo com outros colegas de trabalho.

O seu funcionamento é muito simples. Toda vez que alguém faz uma pergunta no BizChat, pode transformar a resposta que a AI deu em uma Page (página). A resposta fica então salva nesse documento - que é exibido ao lado da sua conversa.

Essa nova Page pode ser compartilhada com outros colegas dentro da organização, que, junto com quem criou, podem editá-la e adicionar novas informações que a AI gerar.

É uma ideia bem interessante e faz bastante sentido.

Copilot nos Apps do Microsft 365

Excel: o Copilot no Excel agora conta com a integração com Python (uma linguagem de programação muito utilizada em ciência de dados). Isso permite que usuários realizem análises avançadas, como previsões e machine learning, sem necessidade de dominar programação.

Essa atualização facilita o uso de fórmulas complexas e visualizações de dados de forma intuitiva.

Assim, mais do que nunca, qualquer pessoa pode fazer análises de qualidade a partir de seus dados do Excel com ajuda da AI.

PowerPoint: no PowerPoint, o Copilot recebeu melhorias que agilizam a criação de apresentações usando AI.

Uma delas é o recurso Narrative Builder. Com ele, o usuário pode fornecer um comando simples (e até referenciar documentos do Word ou outros slides) e obter um esboço inicial de uma apresentação. Esse esboço pode ser editado e refinado até chegar à versão final.

Além disso, o Copilot agora ajuda a garantir que as apresentações geradas com AI estejam alinhadas com a identidade visual da empresa por meio do Brand Manager, que permite criar templates corporativos.

Teams: no Teams, o Copilot foi atualizado para não só monitorar o áudio das reuniões, mas também o chat, para poder gerar, automaticamente, um resumo completo ao final de cada reunião.

Outlook: agora o Copilot é capaz de organizar e destacar os e-mails mais relevantes com base no conteúdo e no contexto de cada usuário.

Desta forma, ele oferece resumos concisos de cada e-mail, explicando por que ele foi priorizado. Isso é bem útil e poupa muito tempo.

Word: no Word, o Copilot facilita o processo de escrita com sugestões automáticas de prompts, ajudando o usuário a organizar suas ideias e iniciar um documento, sem bloqueios criativos.

Agora ele também permite que o usuário referencie, para a AI, informações de outros documentos do Word, Excel, PowerPoint e até mesmo e-mails e reuniões, diretamente no texto.

Agentes Copilot

Finalmente, uma atualização legal desta segunda onda são os Agentes Copilot.

Os agentes são como os GPTs do ChatGPT e permitem que os usuários criem assistentes personalizados em executar tarefas específicas.

Eles são criados através da ferramenta Agent Builder e podem ser acessados no BizChat e compartilhados dentro da organização.

Apesar de não ser muito inovador, esse recurso é bastante útil por integrar aos apps do Microsoft 365, trazer mais segurança dedos e possibilitar o acesso de outros membros da empresa.

No geral, novidades bem interessantes por parte da Microsoft.

Estou curioso para ver como o o1 será integrado no Copilot e quais novas capacidades ele irá debloquear.

Indicações

YouGenie

Ferramenta de AI para YouTubers muito completa. Gere thumbnails, observe concorrentes, analise e responda comentários, crie campanhas e muito mais.

Social AI

Uma rede social onde você é o único humano e todos os outros usuários são AIs. Apesar de distópico, é bem interessante para obter feedback, conselhos e reflexões a cada post que você fizer.

Dica de Uso

Se você está experimentando o novo modelo da OpenAI, o o1, é importante que você saiba como escrever os prompts para ele.

Por funcionar de uma forma diferente dos modelos, você não deve comandá-lo como faz com os outros modelos. Então aqui vão algumas dicas:

Mantenha os prompts simples e diretos: sem instruções muito longas;

Evite prompts de cadeia de pensamento: nada de pedir para “pensar passo a passo” ou explicar o raciocínio;

Use delimitadores para uma formatação mais clara: aspas triplas, tags XML ou títulos de seção ajudam na interpretação do modelo;

Evite dar exemplos: tente não enviar muitos exemplos de como você quer que uma tarefa seja executada;

Limite o contexto adicional: inclua apenas as informações mais relevantes para evitar que o modelo complique demais sua resposta.

Essas são algumas dicas mais gerais, mas na medida em que você for experimentando, ficará mais claro o que funciona e o que não funciona tão bem.

Pensamento do Dia

O desenvolvimento tecnológico não acontece de forma linear. Ele ocorre em saltos.

Então, mesmo que algo pareça estagnado, pode ser que esteja apenas na iminência do próximo grande e disruptivo avanço.

Por hoje é só!

Se está gostando do nosso conteúdo ou tem algum feedback para dar, sinta-se livre para responder o e-mail ou nos mandar mensagem nas redes sociais. Vamos adorar ler!

Aproveita para nos seguir no Instagram e no Tiktok (@revolucao.ai)!

Não se esqueça de compartilhar a newsletter com um amigo para ganhar prêmios!

Tenha uma ótima semana e até semana que vem!