#45 Gemini Lançado e Superando o GPT-4, Nova Ferramenta de Geração de Imagens da Meta e GWM - A Próxima Fronteira dos Modelos de AI

Essa foi uma semana muito movimentada e importante no universo da Inteligências Artificiais Generativas!

Como aqui, na newsletter do Revolução AI, você sempre fica por dentro de tudo que é relevante, os temas de hoje são:

Gemini lançado e superando o GPT-4; Nova ferramenta de geração de imagens com AI da Meta; GWM - A próxima fronteira dos modelos de AI; Gere vídeos criativos com essa ferramenta de AI; Converse sobre finanças com o clone do Primo Rico.

News

Gemini lançado e superando o GPT-4, mas…

O Google acaba de lançar seu mais novo e poderoso modelo de Inteligência Artificial - o Gemini - e tudo indica que o GPT-4 foi finalmente superado!

Nós já havíamos comentado sobre o Gemini em newsletters anteriores. Ele é fruto de uma colaboração entre o laboratório de pesquisa do Google e o DeepMind (laboratório de AI adquirido pelo Google, mas que trabalhava de maneira independente).

E existiam rumores de que o lançamento desse grande modelo de linguagem (LLM) seria adiado para o ano que vem, mas, na quarta-feira passada, todos foram surpreendidos com o anúncio feito pelo Google.

O Gemini foi finalmente lançado e o Google divulgou um relatório técnico, um post em seu blog e vários vídeos demonstrativos sobre ele.

Um desses vídeos viralizou na internet.

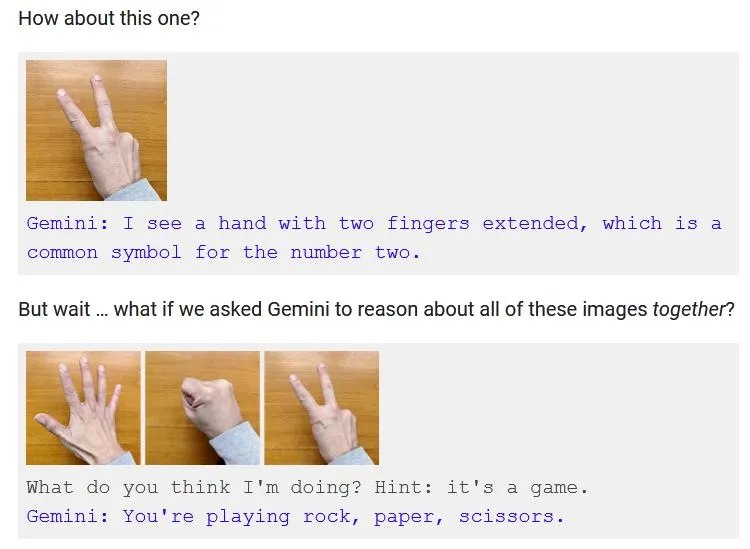

Nele, um usuário fala com o Gemini, que o escuta e enxerga os objetos e gestos que o usuário exibe, respondendo tudo que lhe é solicitado. A interação ocorre em tempo real e é realmente incrível.

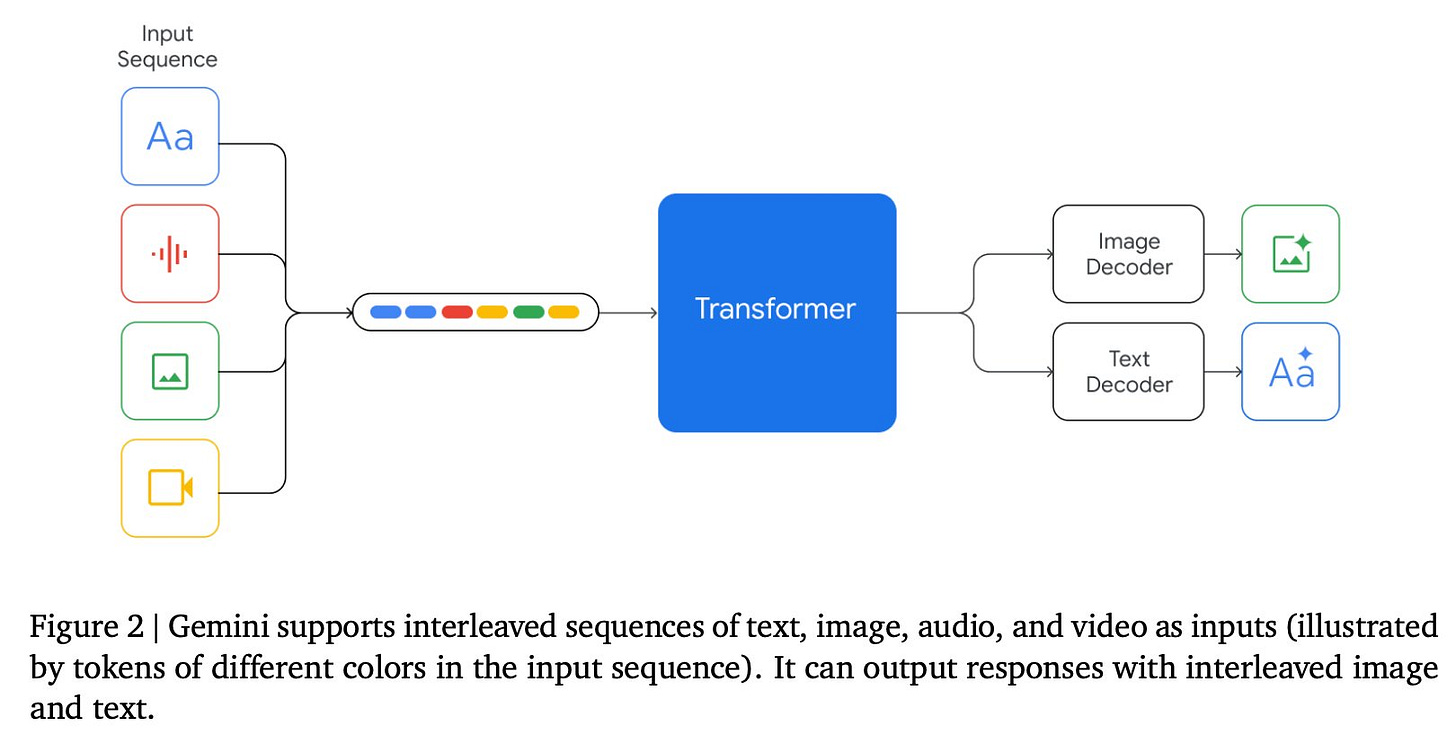

De acordo com as informações divulgadas, o Gemini é multimodal, isso significa que ele é capaz de compreender e interpretar texto, código, áudio, imagem e até vídeo.

Compreender vídeos é uma capacidade inédita, que nenhum LLM possuía até então.

Além disso, o Gemini possui 3 versões:

Ultra - a maior e mais poderosa, requerendo bastante poder computacional.

Nano - a mais leve e eficiente, funcionando até em dispositivos móveis.

Pro - um meio termo entre as duas anteriores.

Mas o quão poderosa e capaz é a versão Ultra?

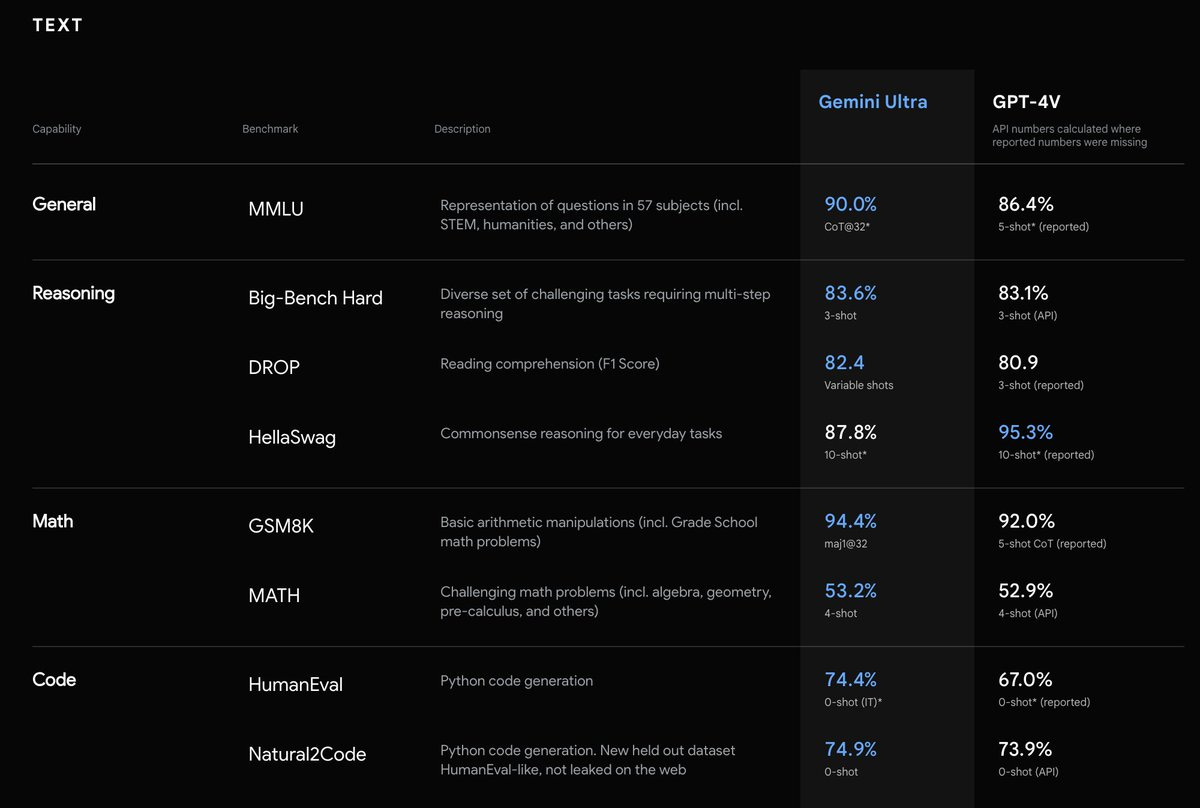

Bom, o Gemini Ultra é o primeiro modelo a superar os especialistas humanos no MMLU (Multi-task Language Understanding), um dos métodos mais populares para testar o conhecimento e as habilidades de resolução de problemas dos modelos de AI.

O Gemini acertou 90% das questões, enquanto a pontuação equivalente a de um expert humano é de 89,8%. Nem o GPT-4 conseguiu atingir esses resultados, acertando 86.4%.

Falando em GPT-4, quando comparado a ele, o Gemini se saiu melhor em 30 de 32 testes, incluindo raciocínio, matemática, programação e interpretação de imagens e áudios, como você pode ver abaixo.

O Gemini se mostrou superior ao GPT-4 na maior parte dos testes - mesmo por uma margem pequena -, alcançando o objetivo inicial do projeto que uniu os laboratórios do Google e do DeepMind.

No entanto, o Gemini não é tão impressionante quanto parece e precisamos fazer algumas ressalvas muito importantes sobre esse lançamento.

Primeiramente, o vídeo demonstrativo que viralizou não é real. O próprio Google admitiu que a demo não foi conduzida em tempo real e, ao invés disso, imagens estáticas e prompts de texto foram enviadas para o Gemini analisar e responder - nada diferente do que já fazemos atualmente com o ChatGPT.

Em segundo lugar, o Google comparou o Gemini com o GPT-4 no MMLU de maneira tendenciosa. Isso pois o Gemini foi testado usando uma técnica de prompt (Chain of Thought) que melhora o raciocínio de modelos de linguagem, enquanto o GPT-4 não obteve essa ajuda.

Finalmente, a versão mais poderosa do Gemini - a Ultra - sequer foi lançada ainda. Apenas a versão Pro (que é um pouco melhor do que o ChatGPT-3.5) está integrada ao Bard (na versão em inglês) e pode ser testada pelas pessoas.

O lançamento da versão Ultra deve acontecer só em 2024 (como o suspeitado) e só então poderemos ver o modelo na prática e fora de testes controlados.

De forma geral, esse lançamento do Gemini mostrou que o Google está claramente atrás da OpenAI. Mesmo tendo mais recursos, computadores e talentos do que qualquer outra empresa do segmento, o Google levou quase um ano para alcançar o GPT-4, que em breve será substituído pelo GPT-5.

E, não satisfeito com isso, ele ainda “maquiou" seus resultados para parecer melhor do que era de fato…

Nova ferramenta de geração de imagens com AI da Meta

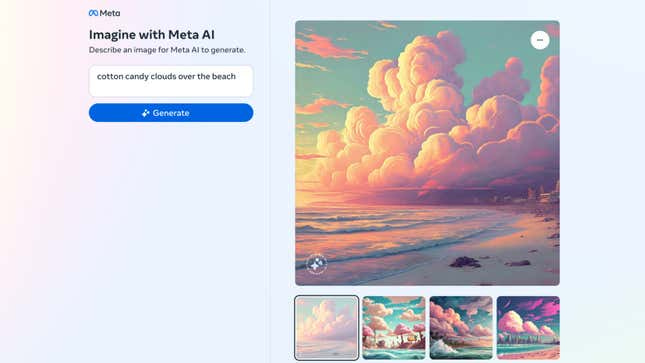

Outro lançamento muito interessante no universo das Inteligências Artificiais foi o da nova ferramenta de geração de imagens da Meta!

Ela se chama Imagine With Meta AI e o modelo que ela utiliza para gerar as imagens se chama Emu.

Nós já falamos do Emu em uma das nossas newsletters. Esse modelo estava sendo utilizado para gerar as figurinhas personalizadas dentro dos aplicativos de mensagem da Meta, como o direct do Instagram e o WhatsApp.

Ele foi treinado com 1,1 bilhão de imagens postadas publicamente no Facebook e Instagram. Pode até ser que suas fotos estejam entre elas…

E agora o Emu tem uma plataforma própria, onde qualquer um pode gerar imagens gratuitamente e de forma ilimitada.

Para gerar imagens na Imagine With Meta AI basta acessar o site e criar uma conta.

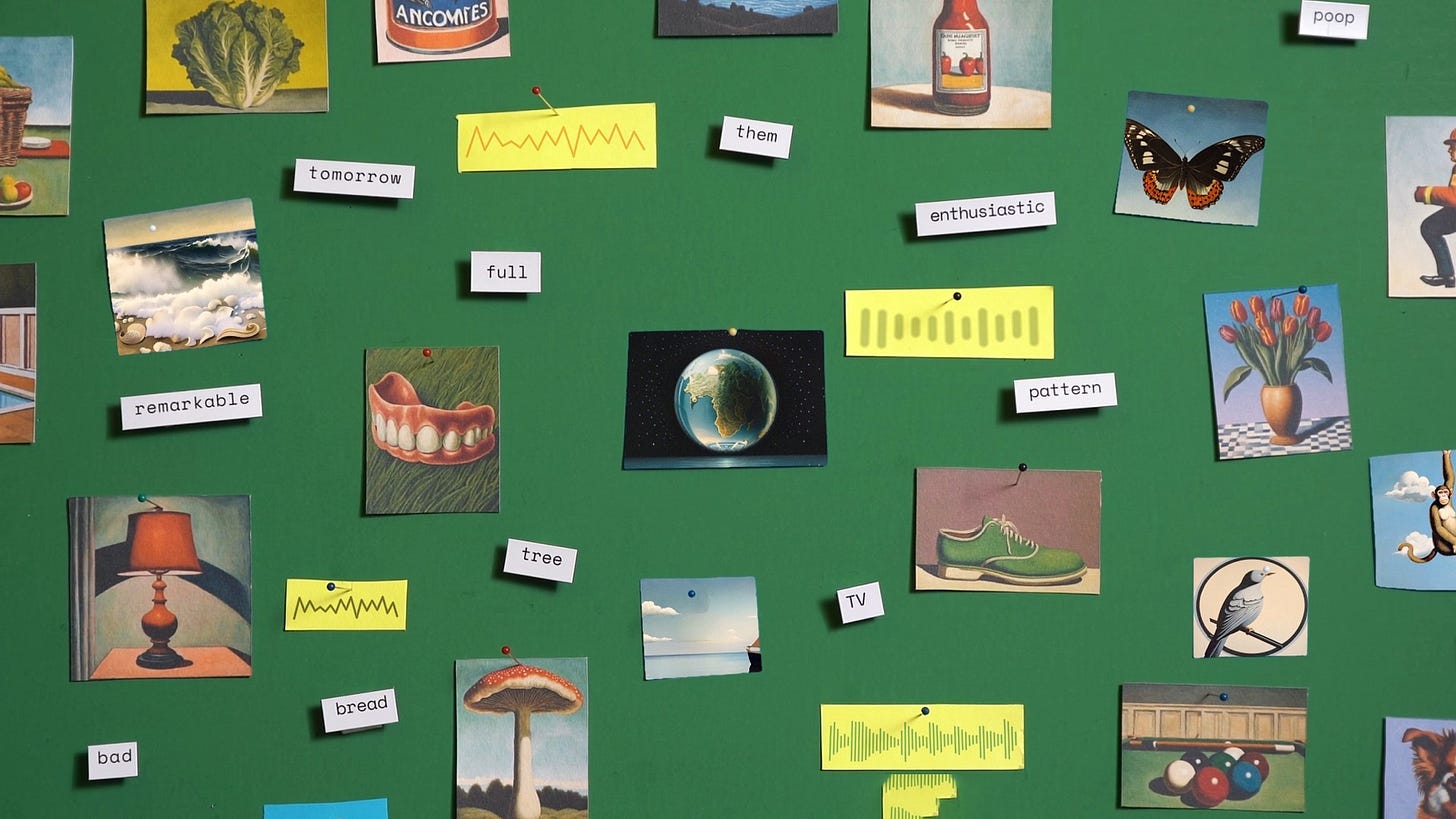

As imagens geradas na ferramenta são de uma qualidade bem alta, como você pode ver abaixo:

Mas como essa ferramenta se compara com os outros modelos, como Midjourney, DALL-E 3 e Adobe Firefly?

O Imagine With Meta AI é:

Muito bom em gerar imagens realistas (de pessoas, animais, coisas, etc.), por conta do tipo de imagem utilizada em seu treinamento. A ferramenta produz resultados até melhores que o DALL-E 3 nesse tipo de imagem, mas não chega ao nível de Midjourney e Firefly;

Não tão bom em seguir instruções complexas, tarefa em que o DALL-E 3 se sai muito bem;

Não tão bom em gerar textos em imagens, se saindo pior que AIs como DALL-E 3 e Ideogram, mas melhor que AIs como Midjourney e Firefly.

De maneira geral, o Imagine With Meta AI é uma das melhores alternativas gratuitas do mercado para gerar imagens com Inteligência Artificial.

Por enquanto a ferramenta está disponível apenas para os Estados Unidos (você pode acessá-la usando VPN), mas, em breve, deve chegar ao Brasil.

GWM - A próxima fronteira dos modelos de AI

Os grandes modelos de linguagem (LLM) são modelos de Inteligência Artificial Generativa, como os que estão por trás do ChatGPT e do Google Bard.

Esses modelos são treinados com quantidades massivas de texto e - falando de maneira simplista - aprendem a prever as palavras e gerar textos que fazem sentido para nós.

De forma geral, quanto mais texto eles conhecem, melhores eles ficam em prever palavras e, com isso, passam a “compreender” melhor o nosso mundo e os padrões nele contidos.

Mas se coloque no lugar dos modelos de linguagem e imagine se toda a sua compreensão do mundo viesse apenas de textos. Se você nunca tivesse ouvido sons ou enxergado nada…

Com certeza essa compreensão seria muito distorcida e limitada.

E esse é justamente um dos problemas dos LLMs. Eles só conhecem textos e entendem o mundo de maneira incompleta, o que também dita negativamente a qualidade daquilo que eles geram.

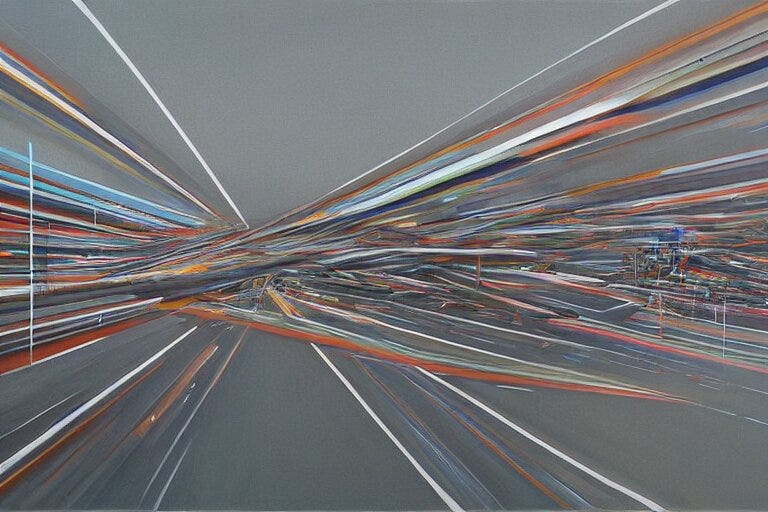

Pensando em solucionar isso, a empresa de geração de vídeos com AI, Runway, está lançando uma nova categoria para os modelos de Inteligência Artificial - os General World Models (GWMs).

Os GWMs serão sistemas projetados para se aproximarem mais da forma que humanos e animais entendem o mundo.

Eles serão treinados com uma grande quantidade de dados, incluindo textos, imagens e vídeos, e serão capazes de construir uma interpretação ou “mapa mental” do mundo mais completo, o que o permitirá criar generalizações de maneira mais fiel.

Compreendendo melhor o mundo, esses novos modelos de AI gerarão respostas muito mais coerentes, realistas e até criativas, nos mais diversos formatos, como texto, imagem e vídeo.

Esses modelos podem ser o próximo salto no universo das Inteligências Artificiais Generativas, porém uma série de desafios ainda estão envolvidos em seu desenvolvimento. De acordo com a própria Runway:

“Para construir GWMs, existem vários desafios de pesquisa abertos nos quais estamos trabalhando. Por um lado, esses modelos precisarão gerar mapas consistentes do ambiente e a capacidade de navegar e interagir nesses ambientes. Precisam captar não apenas a dinâmica do mundo, mas a dinâmica dos seus habitantes, o que envolve também a construção de modelos realistas de comportamento humano.”

Mas mesmo assim, essa é uma área muito interessante em desenvolvimento e nós vamos acompanhar de perto e trazer atualizações.

Indicações

Decohere

Gere vídeos criativos com essa ferramenta de Inteligência Artificial.

Primo AI

Converse sobre finanças com o Thiago Nigro, o Primo Rico.

Dica de Uso

O Bing é uma das ferramentas de AI mais poderosas e subestimadas.

De acordo com o CEO de serviços web da Microsoft, 70% das pessoas o utilizam da maneira errada.

O Chat do Bing pode ser utilizado com o GPT-4 ativado ou não. O que determina sua ativação é o modo que você escolhe.

Existem três modos: criativo, balanceado e preciso.

O balanceado é o padrão e não utiliza o GPT-4, apenas o GPT-3.5 - o que o faz um modo pior. Mesmo assim, a maioria das pessoas usa esse modo por não saber desse detalhe.

Você deve escolher sempre o modo criativo ou preciso, já que eles usam o GPT-4, o modelo de AI mais poderoso da OpenAI.

Agora que você sabe os modos que deve escolher, pode aproveitar vários dos recursos do Bing que nem todo mundo conhece, como análise e geração de imagens.

Nesse video nós falamos mais sobre o Bing, mas ele é a melhor opção de ferramenta de AI para quem não quer assinar o ChatGPT Plus.

Pensamento do Dia

"Success today requires the agility and drive to constantly rethink, reinvigorate, react, and reinvent.”

- Bill Gates

Por hoje é só!

Se está gostando do nosso conteúdo ou tem algum feedback para dar, sinta-se livre para responder o e-mail ou nos mandar mensagem nas redes sociais. Vamos adorar ler!

Aproveita para nos seguir no Instagram e no Tiktok (@revolucao.ai)!

Não se esqueça de compartilhar a newsletter com um amigo para ganhar prêmios!

Tenha uma ótima semana e até segunda!