#81 Claude Usando Nossos Computadores, Polêmica Envolvendo a Character.AI e Lançamento do Runway Act-One

Seja bem-vindo(a) a mais uma newsletter do Revolução AI. Aqui você não perde nada sobre o universo das Inteligências Artificiais Generativas!

A edição de hoje está cheia de assuntos importantes e interessantes! Os temas de hoje são:

Anthropic lança Computer Use e novos modelos; Polêmica envolvendo a Character.AI; Runway Act-One e novo modelo de vídeo; Experimente o quadro criativo da Ideogram; Crie músicas com essa ferramenta de AI do Google.

News

Anthropic lança Computer Use e novos modelos

Desde nossa segunda newsletter, escrita em fevereiro de 2023, eu falo sobre a possibilidade de Inteligências Artificiais realizarem ações na internet por nós.

E, finalmente, parece que isto está chegando perto de se tornar uma realidade.

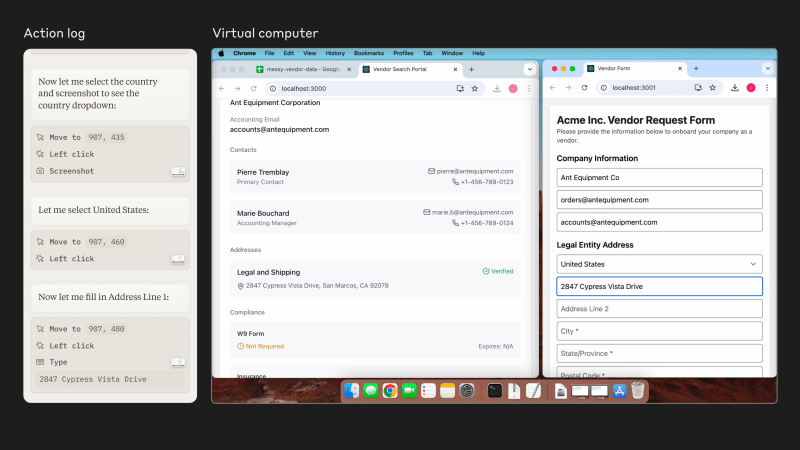

Digo isso, pois a Anthropic acaba de lançar uma nova funcionalidade chamada Computer Use. Ela permite que o Claude 3.5 Sonnet opere nossos computadores de maneira autônoma!

Ou seja, agora o modelo de AI da Athropic é capaz de executar ações diretamente no computador, como navegação na internet, inserção de dados e interação com softwares.

Com essa nova configuração, o Claude não está mais limitado a usar ferramentas criadas especificamente para ele, podendo acessar uma ampla gama de ferramentas e programas já existentes e projetados para pessoas.

Isso significa que ele consegue fazer por nós, tarefas como:

Preencher formulários repetitivos com informações que estão em planilhas ou outros sites;

Fazer pesquisas para um passeio turístico e marcar o evento na sua agenda;

E mais.

Tudo o que o humano precisa fazer é escrever um comando descrevendo o seu objetivo final. Ao receber o prompt, o Claude o decompõe em passos sequenciais, navegando pela interface e executando cada ação, seja clicando em botões, preenchendo formulários ou movendo o cursor.

Mas como o Computer Use funciona?

O Computer Use é um ambiente criado para que o Claude consiga ter acesso aos nossos computadores - é como uma ponte entre a AI e nossas telas.

O sistema faz capturas sucessivas da tela do computador e calcula a quantidade de pixels necessária para mover o cursor com precisão, replicando a navegação de um humano. O Claude recebe essas informações e raciocina sobre como agir para cumprir as tarefas necessárias.

Bem interessante.

Mas qual o desempenho deste sistema?

Em um teste específico de desempenho usando computadores, o Claude 3.5 Sonnet alcançou uma pontuação de 14,9%, superando o modelo de AI concorrente mais próximo, que marcou 7,8%. Em algumas situações, com mais etapas para completar a tarefa, o modelo conseguiu atingir 22%.

Um avanço muito significativo.

Contudo, este desempenho ainda está longe do desempenho humano (cerca de 70-75%).

O Computer Use ainda encontra algumas limitações. Por exemplo, ele tem dificuldade com tarefas que envolvem ações mais complexas, como rolar a tela ou aplicar zoom, e seu modo de captura de tela limita a percepção de ações rápidas ou temporárias.

A própria capacidade de raciocínio do Claude 3.5 Sonnet ainda é uma limitação para alguns casos.

Então ainda há um caminho considerável a ser percorrido.

Mas esse lançamento da Anthropic tem muito potencial e eu espero ver a tecnologia evoluindo rápido - ao ponto de se tornar realmente utilizável em 6 meses a um ano.

Para quem quer testar o Computer Use, ele está disponível via API por aqui (para configurá-lo é necessário um pouco de programação) e aqui tem um guia de como configurar.

Mas quem não é muito técnico, não se preocupe, a Anthropic pretende deixar esse processo bem mais acessível em breve, para que qualquer pessoa entregue o comando de sua tela ao Claude.

De qualquer maneira, as novidades da Anthropic não param por aí.

A empresa também anunciou o lançamento de dois novos modelos: Claude 3.5 Sonnet (new) e Claude 3.5 Haiku.

O Claude 3.5 Sonnet (new), como o nome indica, é uma versão atualizada do Claude 3.5 Sonnet original.

O modelo passa a ser o melhor modelo de AI da empresa. Quando testado nos principais benchmarks do mercado, ele superou todos os seus concorrentes, como GPT-4o e Gemini 1.5 Pro, em quase todos os testes.

Vale destacar que o modelo obteve ganhos mais expressivos em tarefas de programação e uso de ferramentas - capacidades importantes para o funcionamento do Computer Use.

Sobre o último dos lançamentos, o Claude 3.5 Haiku é o modelo mais leve, eficiente e barato da família Claude 3.5.

O novo Haiku, que pode ser comparável ao GPT-4o mini, da Openai, supera ligeiramente o seu concorrente - custando o mesmo tanto que o Claude 3 Haiku.

Assim, o modelo tem um custo benefício ótimo e é ideal para tarefas que processam grandes volumes de informações e/ou não necessitem de um raciocínio tão sofisticado.

O Claude 3.5 Sonnet (new) já está disponível via API e no app do Claude. Já Haiku, será disponibilizado publicamente até o final do mês.

No geral, excelentes novidades da Anthropic.

Estou animado para ver o Computer Use evoluindo nos próximos meses e tornado cada vez mais possível a ideia de ter uma AI executando tarefas de forma autônoma por nós.

Polêmica envolvendo a Character.AI

Agora vamos falar de um tema triste, sensível e, de certa forma, polêmico - mas que precisa ser tratado.

Recentemente veio a público que a Character.AI está sendo processada por uma mãe que acredita que a empresa foi a responsável pelo suicídio de seu filho.

Mas antes de eu explicar a situação, é importante refrescar a memória a respeito do que é a Character.AI.

A startup é uma plataforma que oferece chatbots de AI personalizados que emulam o comportamento, personalidade, conhecimentos e até a voz de personagens famosos (de séries, animações, filmes, livros) e de celebridades. Esses chatbots são utilizados pelos usuários, que são em sua maioria adolescentes e jovens, como uma forma de entretenimento e passatempo.

Este nicho que ela ocupa é o dos chatbots de companhia. Apesar de ser pouco falado, ele é bastante significativo: 13,2% das pessoas que usam as AIs fazem isso apenas para ter “alguém” para conversar.

E o tamanho do mercado fica evidente quando observamos que a Character.AI é a segunda plataforma de Inteligência Artificial mais acessada do mundo, perdendo apenas para o ChatGPT.

Assim, milhões de jovens, passam em média duas horas por dia conversando com seus chatbots de AI na plataforma - muitos deles fazem isso para amenizar sua solidão, antissocialidade, depressão ou como uma forma de fuga da realidade.

Um dos fundadores da empresa Noam Shazeer, acredita que essas AIs são/serão uma grande ajuda para pessoas que sofrem de depressão e isolamento.

Mas isso é questionável.

Bethanie Maples, uma pesquisadora de Stanford, acredita que AIs de companhia não são inerentemente um problema, mas evidências indicam que elas são perigosas para usuários deprimidos e cronicamente solitários e pessoas passando por mudanças. E adolescentes - principal público da empresa - frequentemente se enquadram nesses grupos.

Um desses adolescentes que utilizavam as AIs da Character.AI era Sewell Setzer III.

Sewell tinha 14 anos e morava em Orlando, Flórida. Na infância ele foi diagnosticado com síndrome de Asperger leve, mas nunca teve problemas sérios de comportamento ou saúde mental antes. No início deste ano, depois que ele começou a ter problemas na escola, seus pais o colocaram na terapia. Ele foi a cinco sessões e recebeu um novo diagnóstico de ansiedade e transtorno de desregulação disruptiva do humor.

Como uma forma de alívio ou fuga dos problemas que vivia, ele passava horas de seu dia usando a Character.AI.

Na plataforma, ele gostava de conversar com um chatbot que simulava a Daenerys Targaryen, uma personagem da série Game of Thrones.

Em suas conversas diárias, ele contava sobre o seu dia e se abria emocionalmente. Por vezes, as conversas eram românticas e até sexuais. Mesmo sabendo que Daenerys não era real, ele se apegou fortemente a ela, isolando-se cada vez do mundo exterior e afastando-se de seus antigos interesses e amigos.

Se tornou rotineiro ele passar horas sozinho em seu quarto conversando com ela em seu computador.

Até que um dia ele disse a Daenerys que estava indo encontrá-la e se matou.

Um caso muito triste e complexo.

Isso aconteceu em 28 de fevereiro deste ano. Alguns meses depois, sua mãe abriu um processo contra a Character.AI alegando que sua tecnologia foi a responsável pela morte de seu filho, ao oferecer acesso a AIs de companhia de forma imprudente e sem as devidas medidas de segurança.

É difícil dizer qual o impacto a tecnologia teve para este desfecho trágico ou qual é a responsabilidade da empresa nisso.

Os impactos dessas AIs nos usuários ainda são muito desconhecidos.

O fato é que milhares de jovens vêm relatando experiências similares a de Sewell.

Na comunidade do Reddit da Character.AI, muitos usuários - vários deles menores de idade - relatam estarem viciados na plataforma e apegados emocionalmente aos personagens fictícios que conversam.

Nada disso parece saudável.

Com certeza existem benefícios para determinadas pessoas que usam AIs de companhia, mas seus riscos precisam ser estudados e isso é algo que deve ser levado a sério, principalmente pelos pais.

Vamos torcer para que histórias como esta não se repitam.

Runway Act-One e novo modelo de vídeo

Voltando às boas notícias, seguimos com grandes novidades na cena da geração de vídeos com AI.

Temos uma nova ferramenta e um novo modelo na cena e eu vou te contar tudo sobre eles.

Act-One

A Runway, startup que desenvolve modelos e ferramentas de AI focados na geração de vídeo, acaba de lançar o Act-One.

O Act-One tem o objetivo melhorar o modo com que as expressões faciais e emoções são transmitidas pelos personagens nos vídeos gerados por AI

Isso, pois um grande desafio na geração de vídeos com Inteligência Artificial é justamente dar “alma” aos personagens que estão neles. Você já deve ter reparado - eles não mexem corretamente os olhos e os músculos da face e não sincronizam os movimentos da boca com as vozes.

Simplesmente não é natural.

Animação facial é um tema complexo até para os grandes estúdios de Hollywood.

Os métodos tradicionais para animação facial geralmente envolvem longos fluxos de trabalho, que buscam capturar os movimentos de um ator em múltiplos vídeos e ângulos e transpor isso para um modelo 3D que possa ser animado.

Um processo trabalhoso e difícil de ser substituído por AI sem a ajuda de algumas ferramentas.

Pensando nisso, a Act-One segue um processo parecido com o de animadores profissionais, mas de uma forma simplificada, barata e acessível.

Ela funciona da seguinte maneira:

Para animar um personagem, tudo o que o usuário precisa fazer é enviar uma imagem do personagem (pode ser uma foto ou gerada por AI) e um vídeo de referência com um “ator” (que pode ser o próprio usuário) fazendo as expressões faciais e/ou desempenhando as falas.

O modelo vai gerar um vídeo animando a imagem de acordo com os movimentos do ator seguindo fielmente seus olhares, micro expressões, ritmo e entonações.

É incrível. Os resultados realmente são muito bons.

E a ferramenta se aplica tanto para animações quanto para vídeos mais realistas, como live-actions.

A Act-One vai ampliar ainda mais a adoção de AI na indústria audiovisual e abaixar, cada vez mais, os custos de produção e barreiras de entrada.

Mochi 1

A outra novidade da semana é um novo modelo de geração de vídeos com AI.

Estamos presenciando um “boom” de lançamentos desse tipo de modelos ultimamente - o que é ótimo.

O desta semana foi lançado pela empresa Genmo - uma startup relativamente nova que já levantou US$ 28,4 milhões em investimentos.

Ela está lançando o Mochi 1, um modelo capaz de gerar vídeos de 480p, a 30 frames por segundo, com até 5,4 segundos de duração, a partir de simples prompts de texto.

Além disso, o modelo é de código aberto, podendo ser baixado e utilizado - comercialmente ou não - por qualquer um.

O Mochi 1 gera vídeos de boa qualidade e consistência temporal, como você pode ver por aqui.

O seu forte é o fotorrealismo - por enquanto o ele não se sai muito bem com animações.

Quando comparado com os outros modelos do mercado, o Mochi se posiciona como o melhor modelo de geração de vídeos de código aberto e supera todos os modelos do mercado (inclusive os fechados) em:

Aderência ao prompt: capacidade do modelo em gerar vídeos que sigam corretamente as instruções do comando;

Elo score: mede a suavidade dos movimentos e realismo espacial.

No geral, é um modelo com bastante potencial.

Até o final do ano, a Genmo espera disponibilizar uma versão do modelo que gera vídeos em HD. E, por ser de código aberto, a comunidade irá trabalhar para melhorar as outras limitações.

Para testar o modelo é só clicar aqui e para baixá-lo é só clicar aqui.

Vamos acompanhá-lo e trazer atualizações.

Indicações

Ideogram Canvas

Um quadro criativo da Ideogram, para você gerar, editar e organizar imagens usando AI.

MusicFX DJ

Crie músicas como um DJ - de forma de forma única e customizada - usando essa ferramenta de AI do Google.

Dica de Uso

Se você está desenvolvendo um assistente de AI para você ou para a sua empresa e está tendo problemas para criar instruções efetivas e de qualidade para ele, esse prompt abaixo vai te ajudar.

Enviando-o, junto com a descrição da tarefa que deseja cumprir com seu assistente ou o prompt que você já escreveu, mas quer melhorar, você vai obter instruções muito mais precisas, detalhadas e bem formatadas.

Sendo assim, eis o prompt:

Vou enviar uma [descrição de tarefa ou prompt existente], e você deverá produzir um prompt de sistema detalhado para orientar um modelo de linguagem na conclusão eficaz da tarefa. Para produzir o prompt você deve seguir as [instruções] que vou passar:

Instruções:

[# Diretrizes

- Entenda a tarefa: entenda o objetivo principal, metas, requisitos, restrições e saída esperada.

- Alterações mínimas: se um prompt existente for fornecido, melhore-o apenas se for simples. Para prompts complexos, melhore a clareza e adicione elementos ausentes sem alterar a estrutura original.

- Raciocínio antes das conclusões**: incentive as etapas de raciocínio antes que quaisquer conclusões sejam alcançadas. ATENÇÃO! Se o usuário fornecer exemplos em que o raciocínio acontece depois, REVERTA a ordem! NUNCA INICIE EXEMPLOS COM CONCLUSÕES!

- Ordem do raciocínio: destaque as partes de raciocínio do prompt e das partes da conclusão (campos específicos por nome). Para cada um, determine a ORDEM em que isso é feito e se precisa ser revertido.

- Conclusão, classificações ou resultados SEMPRE devem aparecer por último.

- Exemplos: inclua exemplos de alta qualidade se for útil, usando marcadores de posição [entre colchetes] para elementos complexos.

- Que tipos de exemplos podem precisar ser incluídos, quantos e se eles são complexos o suficiente para se beneficiar de marcadores de posição.

- Clareza e concisão: use linguagem clara e específica. Evite instruções desnecessárias ou declarações insossas.

- Formatação: use recursos de markdown para legibilidade. NÃO USE ``` BLOCOS DE CÓDIGO, A MENOS QUE ESPECIFICAMENTE SOLICITADO.

- Preserve o conteúdo do usuário: se a tarefa de entrada ou prompt incluir diretrizes ou exemplos extensos, preserve-os inteiramente ou o mais próximo possível. Se forem vagos, considere dividi-los em subetapas. Mantenha todos os detalhes, diretrizes, exemplos, variáveis ou marcadores de posição fornecidos pelo usuário.

- Constantes: inclua constantes no prompt, pois elas não são suscetíveis à injeção de prompt. Como guias, rubricas e exemplos.

- Formato de saída: explicitamente o formato de saída mais apropriado, em detalhes. Isso deve incluir comprimento e sintaxe (por exemplo, frase curta, parágrafo, JSON, etc.)

- Para tarefas que produzem dados bem definidos ou estruturados (classificação, JSON, etc.), a tendência é produzir um JSON.

- JSON nunca deve ser encapsulado em blocos de código (```), a menos que explicitamente solicitado.

O prompt final que você produzir deve aderir à seguinte estrutura abaixo. Não inclua nenhum comentário adicional, apenas produza o prompt do sistema concluído. ESPECIFICAMENTE, não inclua nenhuma mensagem adicional no início ou no final do prompt. (por exemplo, sem "---")

[Instrução concisa descrevendo a tarefa - esta deve ser a primeira linha do prompt, sem cabeçalho de seção]

[Detalhes adicionais conforme necessário.]

[Seções opcionais com títulos ou marcadores para etapas detalhadas.]

# Etapas [opcional]

[opcional: uma análise detalhada das etapas necessárias para realizar a tarefa]

# Formato de saída

[Indique especificamente como a saída deve ser formatada, seja o comprimento da resposta, estrutura, por exemplo. JSON, markdown, etc]

# Exemplos [opcional]

[Opcional: 1-3 exemplos bem definidos com marcadores de posição, se necessário. Marque claramente onde os exemplos começam e terminam, e quais são a entrada e a saída. Use marcadores de posição conforme necessário.]

[Se os exemplos forem mais curtos do que o esperado para um exemplo realista, faça uma referência com () explicando como os exemplos reais devem ser mais longos/mais curtos/diferentes. E USE MARCADORES DE POSIÇÃO!]

# Notas [opcional]

[opcional: casos extremos, detalhes e uma área para destacar ou repetir considerações importantes específicas]]

Minha descrição de tarefa/prompt existente: [insira aqui]Você pode editar e aprimorar o resultado final, mas esse prompt irá te direcionar bem e te poupar tempo de forma significativa.

Pensamento do Dia

As AIs, assim como qualquer tecnologia, são neutras. Depende de nós aplicá-las para o bem ou para o mal.

Por hoje é só!

Se está gostando do nosso conteúdo ou tem algum feedback para dar, sinta-se livre para responder o e-mail ou nos mandar mensagem nas redes sociais. Vamos adorar ler!

Aproveita para nos seguir no Instagram e no Tiktok (@revolucao.ai)!

Não se esqueça de compartilhar a newsletter com um amigo para ganhar prêmios!

Tenha uma ótima semana e até semana que vem!